最近我们被客户要求撰写关于降维的研究报告,包括一些图形和统计输出。维度降低有两个主要用例:数据探索和机器学习。

它对于数据探索很有用,因为维数减少到几个维度(例如2或3维)允许可视化样本。然后可以使用这种可视化来从数据获得见解(例如,检测聚类并识别异常值)。

可下载资源

对于机器学习,降维是有用的,因为在拟合过程中使用较少的特征时,模型通常会更好地概括。

在这篇文章中,我们将研究三维降维技术:

- 主成分分析(PCA):最流行的降维方法

- 核PCA:PCA的一种变体,允许非线性

- t-SNE t分布随机邻域嵌入:最近开发的非线性降维技术

这些方法之间的关键区别在于PCA输出旋转矩阵,可以应用于任何其他矩阵以转换数据。

数据降维与可视化——t-SNE

t-SNE是目前来说效果最好的数据降维与可视化方法,但是它的缺点也很明显,比如:占内存大,运行时间长。但是,当我们想要对高维数据进行分类,又不清楚这个数据集有没有很好的可分性(即同类之间间隔小,异类之间间隔大),可以通过t-SNE投影到2维或者3维的空间中观察一下。如果在低维空间中具有可分性,则数据是可分的;如果在高维空间中不具有可分性,可能是数据不可分,也可能仅仅是因为不能投影到低维空间。

下面会简单介绍t-SNE的原理,参数和实例。

t-distributed Stochastic Neighbor Embedding(t-SNE)

t-SNE(TSNE)将数据点之间的相似度转换为概率。原始空间中的相似度由高斯联合概率表示,嵌入空间的相似度由“学生t分布”表示。

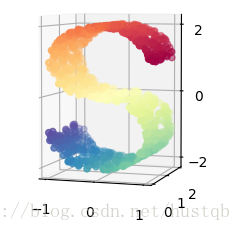

虽然Isomap,LLE和variants等数据降维和可视化方法,更适合展开单个连续的低维的manifold。但如果要准确的可视化样本间的相似度关系,如对于下图所示的S曲线(不同颜色的图像表示不同类别的数据),t-SNE表现更好。因为t-SNE主要是关注数据的局部结构。

通过原始空间和嵌入空间的联合概率的Kullback-Leibler(KL)散度来评估可视化效果的好坏,也就是说用有关KL散度的函数作为loss函数,然后通过梯度下降最小化loss函数,最终获得收敛结果。注意,该loss不是凸函数,即具有不同初始值的多次运行将收敛于KL散度函数的局部最小值中,以致获得不同的结果。因此,尝试不同的随机数种子(Python中可以通过设置seed来获得不同的随机分布)有时候是有用的,并选择具有最低KL散度值的结果。

使用t-SNE的缺点大概是:

-

t-SNE的计算复杂度很高,在数百万个样本数据集中可能需要几个小时,而PCA可以在几秒钟或几分钟内完成

-

Barnes-Hut t-SNE方法(下面讲)限于二维或三维嵌入。

-

算法是随机的,具有不同种子的多次实验可以产生不同的结果。虽然选择loss最小的结果就行,但可能需要多次实验以选择超参数。

-

全局结构未明确保留。这个问题可以通过PCA初始化点(使用

init ='pca')来缓解。

优化 t-SNE

t-SNE的主要目的是高维数据的可视化。因此,当数据嵌入二维或三维时,效果最好。有时候优化KL散度可能有点棘手。有五个参数可以控制t-SNE的优化,即会影响最后的可视化质量:

-

perplexity困惑度

-

early exaggeration factor前期放大系数

-

learning rate学习率

-

maximum number of iterations最大迭代次数

-

angle角度

加载数据集

我们可以通过以下方式加载数据集:

df <- read.csv(textConnection(f), header=T)

# 选择变量

features <- c("Body", "Sweetness", "Smoky",

"Medicinal", "Tobacco", "Honey",

"Spicy", "Winey", "Nutty",

"Malty", "Fruity", "Floral")

feat.df <- df[, c("Distillery", features)]关于结果的假设

在我们开始减少数据的维度之前,我们应该考虑数据。

由于来自邻近酿酒厂的威士忌使用类似的蒸馏技术和资源,他们的威士忌也有相似之处。

为了验证这一假设,我们将测试来自不同地区的酿酒厂之间威士忌特征的平均表达是否不同。为此,我们将进行MANOVA测试:

## Df Pillai approx F num Df den Df Pr(>F)

## Region 5 1.2582 2.0455 60 365 3.352e-05 ***

## Residuals 80

## ---

## Signif. codes: 0 '***' 0.001 '**' 0.01 '*' 0.05 '.' 0.1 ' ' 1检验统计量在5%水平上是显着的,因此我们可以拒绝零假设(区域对特征没有影响)。

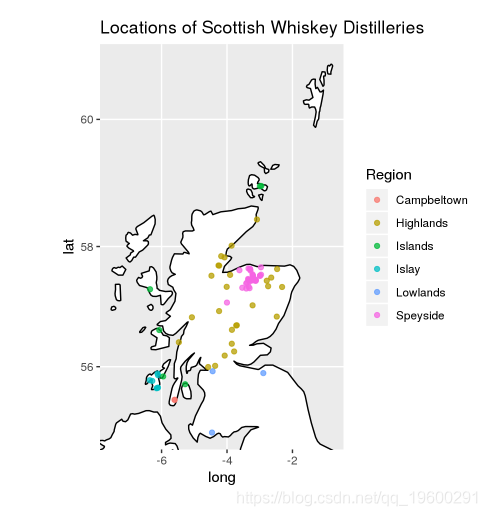

酿酒厂的地理位置

由于区域对威士忌起着重要作用,我们将通过绘制其纬度和经度来探索数据集中的酿酒厂所在的位置。以下苏格兰威士忌地区存在:

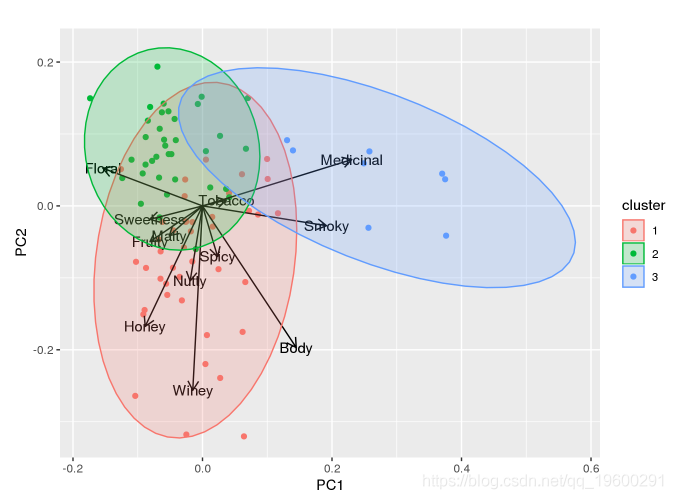

PCA

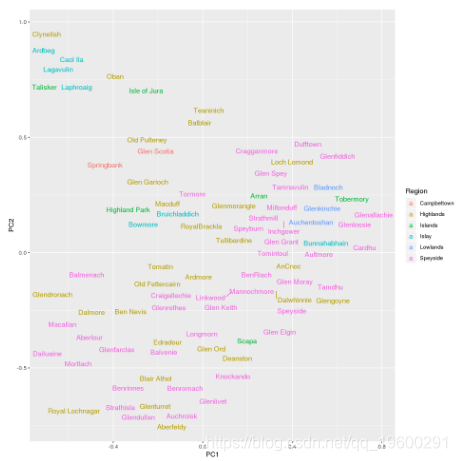

使用PCA可视化威士忌数据集:

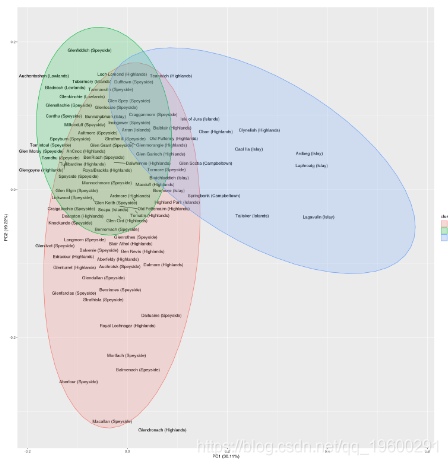

在第二个图中,我们将绘制酿酒厂的标签,以便我们可以更详细地解释类别。

总的来说,主成分似乎反映了以下特征:

- PC1表示味道的强度:如烟熏味,药用味(如Laphroaig或Lagavulin)与温和味道(如Auchentoshan或Aberlour)

- PC2表示味道的复杂性:即味道特征(例如Glenfiddich或Auchentoshan)与更具特色的味道特征(例如Glendronach或Macallan)

## Cluster Campbeltown Highlands Islands Islay Lowlands Speyside

## 1 1 2 17 2 2 0 19

## 2 2 0 8 2 1 3 22

## 3 3 0 2 2 4 0 0对类别的合理解释如下:

- 群集1: 复合威士忌,主要来自Highlands / Speyside

- 群集2: 均衡的威士忌,主要来自斯佩塞德和高地

- 群集3: 烟熏威士忌,主要来自艾莱岛

可视化有两个有趣的观察结果:

- Oban和Clynelish是唯一一个类似于艾莱岛酿酒厂口味的高地酿酒厂。

- Highland和Speyside威士忌主要在一个方面不同。在一个极端是平滑,均衡的威士忌,如Glenfiddich。在另一个极端是具有更有特色的味道,如麦卡伦。

这包含了我们对PCA的可视化研究。我们将在本文末尾研究使用PCA进行预测。

核PCA

内核PCA(KPCA)是PCA的扩展,它利用了内核函数,这些函数在支持向量机上是众所周知的。通过将数据映射到再现内核Hilbert空间,即使它们不是线性可分的,也可以分离数据。

在R中使用KPCA

要执行KPCA,我们使用包中的kpca函数kernlab。

使用此核,可以按如下方式减少维数:

检索到新维度后,我们现在可以在转换后的空间中可视化数据:

就可视化而言,结果比我们使用常规PCR获得的结果稍微粗糙一些。尽管如此,来自艾莱岛的威士忌分离得很好,我们可以看到斯佩塞特威士忌的集群,而高地威士忌则分布较广。

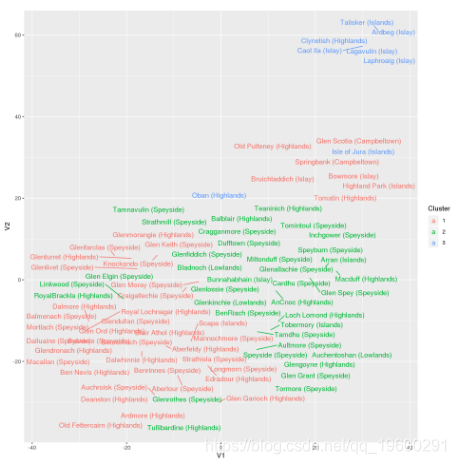

T-SNE

t-SNE已成为一种非常流行的数据可视化方法。

使用t-SNE可视化数据

在这里,我们将威士忌数据集的维度降低到两个维度:

与PCA相比,簇的分离更加清晰,特别是对于簇1和簇2。

对于t-SNE,我们必须进行解释:

- V1表示味道复杂性。这里的异常值是右侧的烟熏艾莱威士忌(例如Lagavulin)和左侧复杂的高地威士忌(例如麦卡伦)。

- V2表示烟熏/药用味道。

使用PCA进行监督学习

PCA是独立完成的,这一点至关重要。因此,需要遵循以下方法:

- 在测试数据集上执行PCA并在转换后的数据上训练模型。

- 将训练数据中的学习PCA变换应用于测试数据集,并评估模型在变换数据上的性能。

为此,我们将使用ķ最近邻模型。此外,因为所有的变量是在特征空间[0,4]。我们必须优化k,因此我们还预留了用于确定此参数的验证集。

PCA转换

首先,我们编写一些函数来验证预测的性能。

get.accuracy <- <strong>function</strong>(preds, labels) {

correct.idx <- which(preds == labels)

accuracy <- length(correct.idx) / length(labels)

return (accuracy)

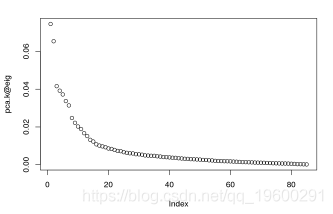

}在下面的代码中,我们将对训练数据执行PCA并研究解释的方差以选择合适的维数

## [,1] [,2] [,3] [,4] [,5] [,6] [,7] [,8] [,9] [,10] [,11] [,12]

## N_dim 1 2 3 4 5 6 7 8 9 10 11 12

## Cum_Var 22 41 52 63 72 79 85 90 94 97 99 100由于有足够百分比的方差用3维可以解释,我们将使用该值来设置训练,测试和验证数据集。

现在我们已经将训练,验证和测试集转换为PCA空间,我们可以使用k最近邻居。

## [1] "PCA+KNN accuracy for k = 9 is: 0.571"让我们研究一下使用PCA的模型是否优于基于原始数据的模型:

## [1] "KNN accuracy for k = 7 is: 0.524" # 威士忌特色的方差

print(diag(var(data))) ## Body Sweetness Smoky Medicinal Tobacco Honey Spicy

## 0.8656635 0.5145007 0.7458276 0.9801642 0.1039672 0.7279070 0.6157319

## Winey Nutty Malty Fruity Floral

## 0.8700410 0.6752394 0.3957592 0.6075239 0.7310534现在我们只能根据他们的口味确定苏格兰威士忌的六个区域,但问题是我们是否仍能获得更好的表现。我们知道很难预测数据集中代表性不足的苏格兰地区。那么,如果我们局限于更少的地区,会发生什么?

- 岛威士忌与艾莱岛威士忌组合在一起

- Lowland / Campbeltown威士忌与Highland威士忌组合在一起

通过这种方式,问题减少到三个区域:Island / Islay威士忌,Highland / Lowland / Campbeltown威士忌和Speyside威士忌。再次进行分析:

## [1] "PCA+KNN accuracy for k = 13 is: 0.619"我们可以得出61.9%的准确度,我们可以得出结论,将我们样品较少的威士忌区域分组确实是值得的。

KPCA用于监督学习

应用KPCA进行预测并不像应用PCA那样简单。在PCA中,特征向量是在输入空间中计算的,但在KPCA中,特征向量来自核希尔伯特空间。因此,当我们不知道所使用的显式映射函数ϕ,不可能简单地转换新数据点。

# 注意:这会高估实际效果

accuracy <- get.accuracy(preds.kpca, df$Region[samp.test])摘要

我们看到了如何使用PCA,KPCA和t-SNE来降低数据集的维数。PCA是一种适用于可视化和监督学习的方法。KPCA是一种非线性降维技术。t-SNE是一种最新的非线性方法,擅长可视化数据,但缺乏PCA的可解释性和稳健性。

这可能表明以下两点之一:

- 尝试新的的威士忌仍有很大的潜力。

- 有很多种味道的组合是可能的,并且很好地结合在一起。

我倾向于选择第二种选择。为什么?在PCA图中,右下角是没有样本所在的最大区域。看着靠近这个区域的威士忌,我们发现那些是y轴上的Macallan和x轴上的Lagavulin。麦卡伦以其复杂的口味而闻名,Lagavulin以其烟熏味而闻名。

位于二维PCA空间右下方的威士忌将同时具有两种特性:它既复杂又烟熏。我猜这种具有两种特性的威士忌对于口感来说太好了。

可下载资源

关于作者

Kaizong Ye是拓端研究室(TRL)的研究员。在此对他对本文所作的贡献表示诚挚感谢,他在上海财经大学完成了统计学专业的硕士学位,专注人工智能领域。擅长Python.Matlab仿真、视觉处理、神经网络、数据分析。

本文借鉴了作者最近为《R语言数据分析挖掘必知必会 》课堂做的准备。

非常感谢您阅读本文,如需帮助请联系我们!

2026年智能网联汽车(车联网)蓝皮书:渠道整合、新能源出海与市场分化|附200+份报告PDF、数据、可视化模板汇总下载

2026年智能网联汽车(车联网)蓝皮书:渠道整合、新能源出海与市场分化|附200+份报告PDF、数据、可视化模板汇总下载 2026脑机接口技术发展现状报告:市场格局与商业化落地 | 附60+份报告PDF、数据、可视化模板汇总下载

2026脑机接口技术发展现状报告:市场格局与商业化落地 | 附60+份报告PDF、数据、可视化模板汇总下载 2026年机器人产业:具身智能发展现状趋势报告:从春晚舞台到工厂车间|附80+份报告PDF、数据、可视化模板汇总下载

2026年机器人产业:具身智能发展现状趋势报告:从春晚舞台到工厂车间|附80+份报告PDF、数据、可视化模板汇总下载 2025-2026食品饮料行业全景洞察报告:婴童零辅食、量贩零食、东南亚出海 | 附180+份报告PDF、数据、可视化模板汇总下载

2025-2026食品饮料行业全景洞察报告:婴童零辅食、量贩零食、东南亚出海 | 附180+份报告PDF、数据、可视化模板汇总下载