DT-LoRA-GPT2大语言模型LLM与高效微调量化交易策略学习:强化学习RL智能体与DJIA股票数据的实证研究

作为一名长期深耕在机器学习和算法领域的从业者,我经常被问到这样一个问题:“如何让AI在真实、高风险的环境中学会做决策?”

成为新会员获取本项目完整代码数据资料

引言:当量化交易遇见大语言模型

作为一名长期深耕在机器学习和算法领域的从业者,我经常被问到这样一个问题:“如何让AI在真实、高风险的环境中学会做决策?”尤其是在量化交易领域,这个问题变得更加棘手。传统的强化学习智能体需要与市场进行大量试错交互,这在现实中几乎不可行,一次错误的交易就可能带来巨大损失。这就像让一个新手在没有教练的情况下,直接拿着真金白银去金融市场“练习”,风险不言而喻。

本项目完整代码数据资料

本文内容改编自过往客户咨询项目的技术沉淀并且已通过实际业务校验,该项目完整代码与数据已分享至交流社群。阅读原文进群获取完整代码数据及更多最新AI见解和行业洞察,可与900+行业人士交流成长;还提供人工答疑,拆解核心原理、代码逻辑与业务适配思路,帮大家既懂怎么做,也懂为什么这么做;遇代码运行问题,更能享24小时调试支持。

我们的客户当时正面临一个典型的挑战:他们拥有海量的历史交易数据,但如何让AI模型从这些“过往经验”中学习,而不需要再冒着真金白银的风险去尝试,成为了项目成功的关键。这个需求直接指向了离线强化学习(Offline RL)——一种让智能体从静态数据集中学习的范式。

然而,纯粹的离线强化学习也有其短板。金融时间序列数据复杂,依赖性强,传统的模型要么难以捕捉其中的长程依赖,要么容易“死记硬背”历史模式,导致在未知的市场环境下表现不佳。这就像学生只学会了刷题,却没有理解题目背后的原理,一旦题目稍有变化,就不知所措。

为了解决这个问题,我们在项目中提出了一个大胆的设想:能否借助大语言模型(LLM)强大的泛化能力和模式识别能力,来提升离线强化学习在金融领域的表现?毕竟,语言模型能够从海量的文本中学习到世界的规律,这种“先验知识”或许也能帮助模型更好地理解金融市场的时间序列结构。于是,我们将决策变换器(Decision Transformer, DT)与GPT-2预训练模型结合,并引入**低秩适配(LoRA)**进行参数高效微调,最终形成了一个名为 “DT-LoRA-GPT2” 的解决方案。

本文正是对这个咨询项目技术方案的学术化总结与提炼。我们将手把手带大家复现这个项目,从数据获取、环境构建,到模型选择、代码实现,再到结果解读与稳健性检验,力求为正在为毕业论文或研究项目发愁的同学,提供一个既前沿又务实的完整范例。接下来,让我们用一张流程图来总览整个研究的脉络:

量化交易策略学习流程

│

├── 数据准备阶段

│ ├── 获取DJIA股票历史数据

│ └── 构建交易环境与数据预处理

│

├── 专家策略生成阶段

│ ├── 训练5种强化学习智能体 (A2C, DDPG, PPO, TD3, SAC)

│ └── 收集“专家轨迹”数据

│

├── 离线策略学习阶段

│ ├── 核心模型: DT-LoRA-GPT2 (创新点)

│ └── 对比基线: BC, IQL, CQL, DT-LoRA (随机初始化)

│

└── 策略评估阶段

├── 测试集回测

├── 关键指标对比: 累计收益、最大回撤、夏普比率

└── 结论与展望

图1: 决策变换器(DT)与GPT-2权重初始化及LoRA微调的整体架构

1. 选题背景与研究意义

量化交易策略的开发对于金融机构实现收益最大化和风险控制至关重要。传统方法依赖人工设计的特征和规则系统,难以适应金融市场的动态性和复杂性。强化学习(RL)为自动化优化交易策略提供了新途径,但将其应用于实时交易场景面临巨大挑战,因为在线探索与市场交互的成本和风险极高。

为了规避这些风险,离线强化学习应运而生。它利用历史交互数据来训练智能体,无需与环境进行额外交互。然而,现有的离线强化学习方法在应用于量化交易时,常面临两大难题:一是难以捕捉金融时间序列中复杂的时序依赖关系;二是容易过拟合历史数据,导致在未知市场条件下表现不佳。此外,金融市场中稀疏和延迟的奖励信号,也使得传统离线强化学习方法难以学到最优策略。

近期,序列建模领域,特别是决策变换器(DT)的提出,为解决这些问题提供了新思路。DT将强化学习重构为序列建模问题,利用自注意力机制捕捉长程依赖。但DT模型本身也依赖于大量数据进行训练,而金融数据往往在多样性上存在局限。

本研究旨在探索一种新方法,通过引入预训练大语言模型的知识来增强决策变换器。我们将DT模型与GPT-2预训练权重结合,并采用低秩适配(LoRA)进行参数高效微调。这样做既能利用GPT-2在通用领域学到的丰富特征表示,提升模型对金融数据复杂模式的泛化能力,又能通过LoRA极大地减少可训练参数,使得在有限数据上的微调变得可行且高效。本研究的结果有望为离线强化学习在金融领域的应用开辟新的路径,并为后续研究提供有价值的参考。

2. 数据来源与预处理全流程

本研究使用的数据来自道琼斯工业平均指数(DJIA)及其成分股的历史价格。该数据集在量化交易研究中被广泛采用,能较好地反映金融市场整体情况。我们通过FinRL框架提供的工具获取和整理数据。

数据集划分:

- 训练集:2009年1月1日至2020年7月1日,共约2,892个交易日。

- 测试集:2020年7月1日至2021年10月29日,共约335个交易日。

数据预处理与特征构建:

我们从原始价格数据中构建了多个技术指标(INDICATORS),这些指标作为模型输入的一部分,帮助模型捕捉市场趋势和动能。指标列表见FinRL库的config.py文件。

环境设置:

我们使用StockTradingEnv模拟一个股票交易环境。环境的关键参数如下:

import pandas as pd

from finrl.meta.env_stock_trading.env_stocktrading import StockTradingEnv

from finrl.config import INDICATORS

# ... (加载数据 train_df, test_df的代码,略) ...

# 获取股票数量和状态空间维度

n_stocks = len(test_df['tic'].unique()) # 股票数量

state_space_dim = 1 + 2 * n_stocks + len(INDICATORS) * n_stocks # 状态空间维度计算

# 设置交易成本参数 (买入和卖出成本均为0.1%)

purchase_cost = [0.001] * n_stocks

sale_cost = [0.001] * n_stocks

initial_shares = [0] * n_stocks

# 环境核心参数

env_config = {

"max_shares": 100, # 单次交易最大股数

"init_cash": 1000000, # 初始资金

"init_holdings": initial_shares, # 初始持仓

"purchase_pct": purchase_cost, # 买入费率

"sale_pct": sale_cost, # 卖出费率

"state_space_dim": state_space_dim, # 状态空间维度

"n_stocks": n_stocks, # 股票数量

"indicators": INDICATORS, # 技术指标列表

"action_space_dim": n_stocks, # 动作空间维度

"reward_scale_factor": 1e-4 # 奖励缩放因子

}

# 创建训练环境实例

training_env = StockTradingEnv(df = train_data, **env_config)

代码解释:

n_stocks: 从测试数据中动态获取股票数量。state_space_dim: 计算状态空间的维度。1代表现金,2*n_stocks代表各股票的价格和持仓信息,len(INDICATORS)*n_stocks代表所有股票的技术指标。env_config: 定义环境参数,包括最大持仓、初始资金、交易成本等。

3. 模型选择逻辑与完整代码实现

我们选择决策变换器(DT)作为核心模型,因为它天然适合处理序列数据,能够利用自注意力机制学习长期依赖。但DT需要大量数据进行训练。为了解决金融数据多样性不足的问题,我们引入预训练的GPT-2模型权重。GPT-2作为大语言模型,在海量文本上训练,掌握了丰富的语言结构和语义知识,这些“先验知识”可以帮助DT模型更好地理解金融时间序列的抽象模式。

核心创新点:

- 模型初始化:使用预训练的GPT-2权重初始化决策变换器(DT)的主体架构,而非随机初始化。

- 参数高效微调:采用低秩适配(LoRA)技术,仅在Transformer的注意力层中引入少量可训练参数(低秩矩阵),冻结原始权重,从而实现高效且不易过拟合的微调。

- 输入对齐:将交易数据(状态、动作、目标收益)的嵌入形式与GPT-2的输入格式对齐,使得预训练模型的知识可以被有效利用。

我们实现了一个完整的训练脚本,用于加载专家轨迹、初始化模型并进行训练。以下为核心代码片段:

# ... (导入库的代码略) ...

import loralib as lora

import torch

from decision_transformer.models.decision_transformer import DecisionTransformer

def dt_training_pipeline(model_config):

# 设置随机种子以确保可复现性

torch.manual_seed(model_config["random_seed"])

device = model_config.get("compute_device", "cuda:0") # 选择计算设备

# --- 1. 加载专家轨迹数据 ---

trajectory_path = model_config["data_path"]

with open(trajectory_path, "rb") as f:

expert_trajectories = pickle.load(f)

# --- 2. 定义模型初始化逻辑 ---

if model_config["model_type"] == "dt":

print("正在初始化决策变换器(DT)模型...")

# 此处省略了DecisionTransformer模型的初始化参数配置,如状态维度、动作维度等

dt_model = DecisionTransformer(

args=model_config,

state_dim=..., # 状态维度

act_dim=..., # 动作维度

# ... 其他参数

)

print("模型适配模式:", model_config["use_adaptation"])

# --- 3. 配置参数高效微调(LoRA)---

if model_config["use_adaptation"]:

if model_config["enable_lora"]:

# 仅标记LoRA参数为可训练

lora.mark_only_lora_as_trainable(dt_model, bias='lora_only')

print("已添加LoRA适配器,仅训练LoRA参数。")

# ... 可以进一步控制是否训练嵌入层、层归一化等

# ... 如果模型类型是行为克隆(BC),则初始化MLP模型

else:

raise NotImplementedError("当前仅支持'dt'模型类型")

# --- 4. 统计可训练参数数量 ---

trainable_params = 0

frozen_params = 0

for param in dt_model.parameters():

if param.requires_grad:

trainable_params += param.numel()

else:

frozen_params += param.numel()

print(f"可训练参数数量: {trainable_params}")

print(f"冻结参数数量: {frozen_params}")

print(f"参数训练比例: {trainable_params/(trainable_params + frozen_params):.2%}")

# 将模型移动到指定设备

dt_model = dt_model.to(device=device)

# ... (后续步骤:优化器设置、数据加载、训练循环等,略) ...

代码解释:

dt_training_pipeline: 主训练函数。lora.mark_only_lora_as_trainable: 这个函数是关键,它将模型中所有标记为LoRA的参数(即我们注入的低秩矩阵A和B)设置为可训练,而冻结原始模型的其他所有参数。- 参数统计:我们打印出可训练和冻结的参数数量。在我们的配置下,使用LoRA后,可训练参数仅占总参数的不到1%(约0.726%),极大提高了训练效率并降低了过拟合风险。

4. 模型结果对比与学术化解读

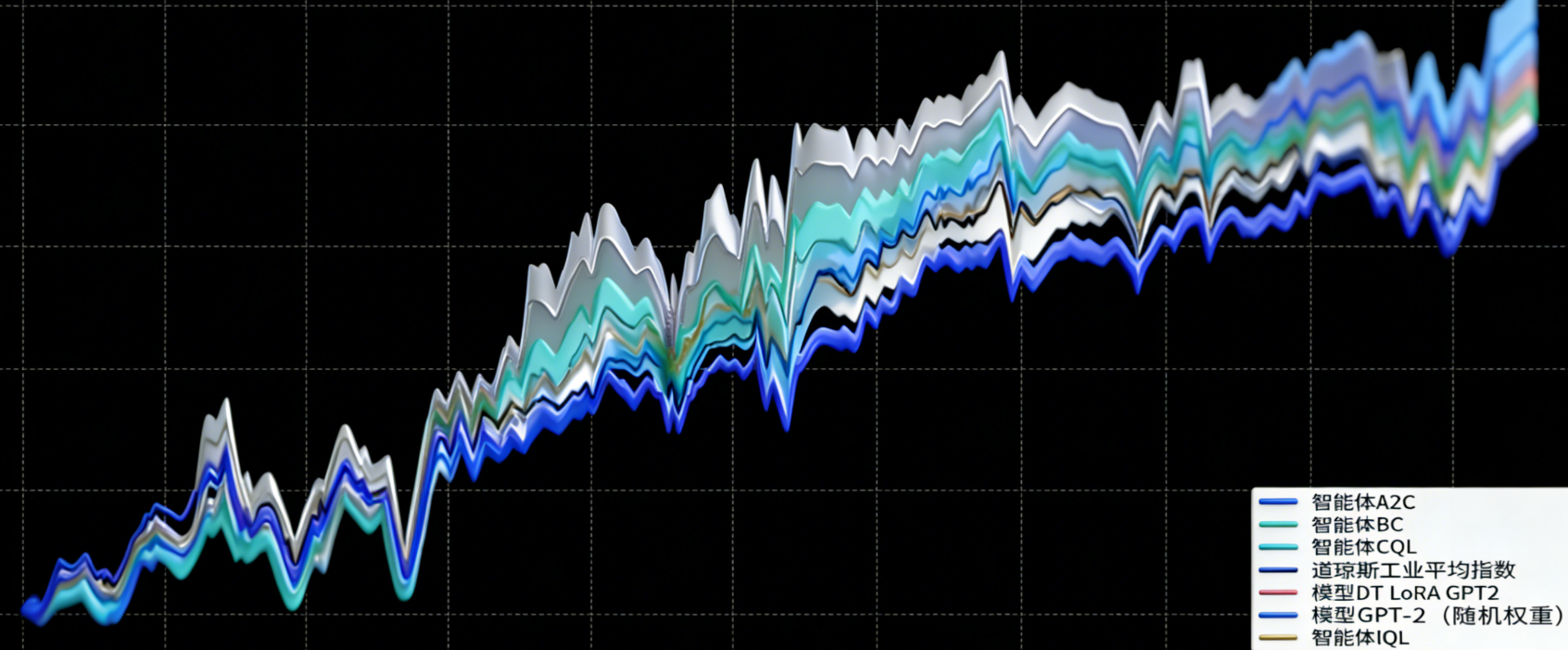

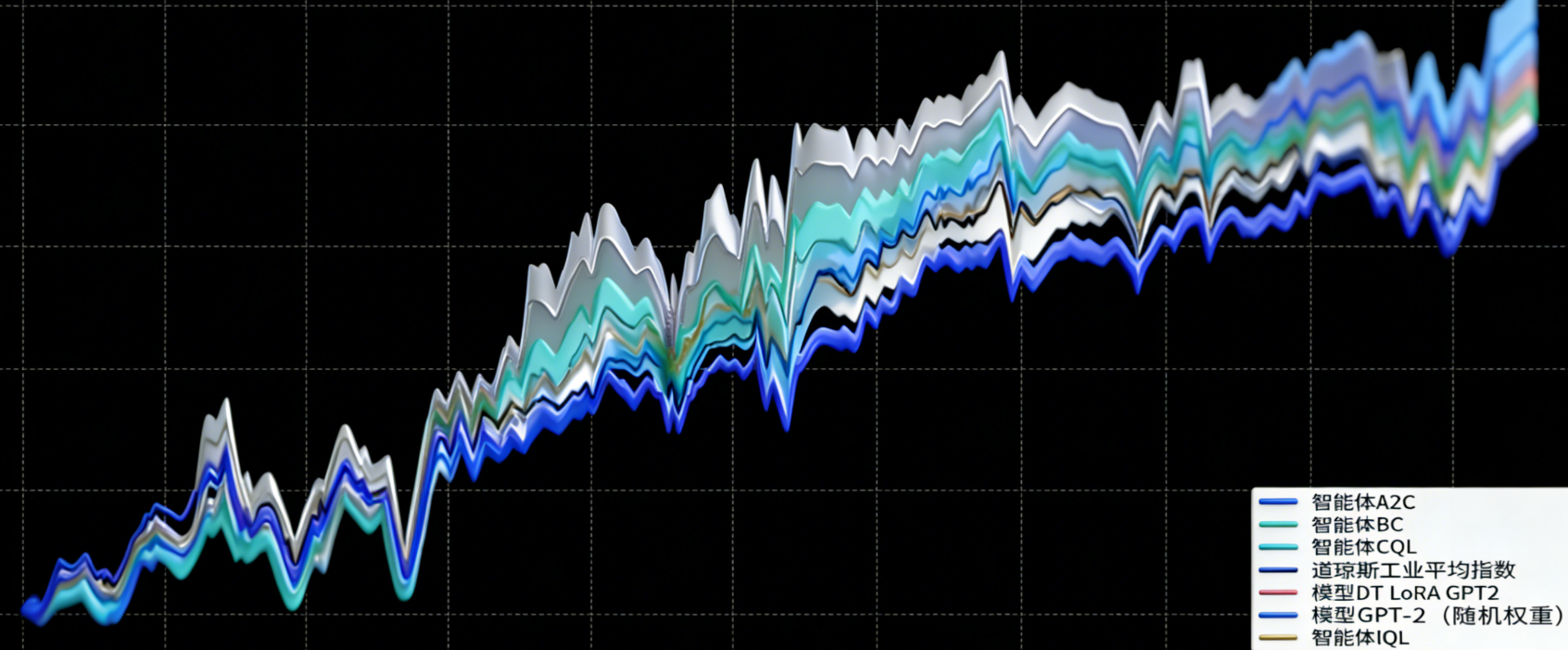

我们在五种专家智能体(A2C、DDPG、PPO、TD3、SAC)生成的轨迹上,训练了我们的DT-LoRA-GPT2模型,并与几种基线方法进行了对比:行为克隆(BC)、隐式Q学习(IQL)、保守Q学习(CQL),以及一个随机初始化的决策变换器+LoRA模型。

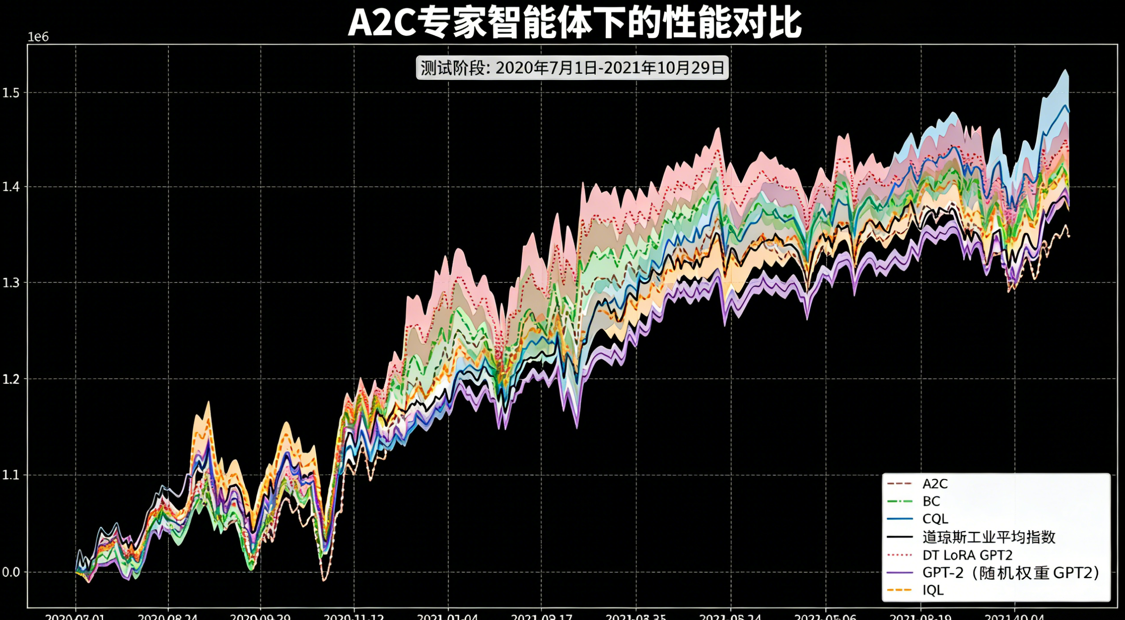

图2直观地展示了在不同专家策略下,各方法在测试集上的累计收益曲线。例如,在A2C专家轨迹上训练时,DT-LoRA-GPT2的累计收益曲线不仅平滑,而且最终收益超过了原始的A2C专家本身。

图2: 基于A2C专家轨迹训练的离线强化学习模型累计收益对比

注:DT-LoRA-GPT2模型表现出了与原始A2C专家及其他基线模型相当的竞争性表现。

表1:离线强化学习方法性能指标对比

| 专家算法 | 方法 | 累计收益 (%) | 最大回撤 (%) | 夏普比率 |

|---|---|---|---|---|

| A2C | A2C (专家) | 34.69 ± 0.00 | -9.12 ± 0.00 | 1.60 ± 0.00 |

| DT LoRA GPT-2 | 43.72 ± 2.04 | -8.42 ± 0.57 | 1.76 ± 0.08 | |

| CQL | 48.00 ± 3.75 | -9.32 ± 0.00 | 2.23 ± 0.10 | |

| IQL | 40.26 ± 3.24 | -10.12 ± 0.58 | 1.84 ± 0.15 | |

| BC | 40.10 ± 1.22 | -8.24 ± 0.43 | 1.71 ± 0.11 | |

| TD3 | TD3 (专家) | 46.69 ± 0.00 | -7.51 ± 0.00 | 2.14 ± 0.00 |

| DT LoRA GPT-2 | 46.62 ± 0.58 | -7.52 ± 0.16 | 2.14 ± 0.03 | |

| CQL | 45.05 ± 0.00 | -7.88 ± 0.00 | 2.06 ± 0.00 | |

| IQL | 39.62 ± 4.43 | -8.18 ± 0.32 | 1.94 ± 0.16 | |

| BC | 43.22 ± 0.12 | -8.34 ± 0.03 | 1.98 ± 0.00 | |

| SAC | SAC (专家) | 47.34 ± 0.00 | -8.67 ± 0.00 | 1.86 ± 0.00 |

| DT LoRA GPT-2 | 39.59 ± 3.18 | -8.54 ± 0.14 | 1.69 ± 0.01 | |

| CQL | 35.07 ± 1.20 | -8.59 ± 0.13 | 1.64 ± 0.05 | |

| IQL | 31.07 ± 3.41 | -8.80 ± 0.19 | 1.56 ± 0.14 | |

| BC | 35.10 ± 1.61 | -9.27 ± 0.09 | 1.59 ± 0.02 |

学术化解读:

- DT-LoRA-GPT2的有效性:从表1可见,我们的模型在所有专家场景下均表现出了很强的竞争力。特别是在A2C和TD3专家轨迹上,其累计收益和夏普比率均位居前列,甚至超越了原始专家。这表明,通过预训练语言模型的知识迁移,我们的模型成功地从历史经验中“学会了”如何更有效地交易,而非简单模仿。

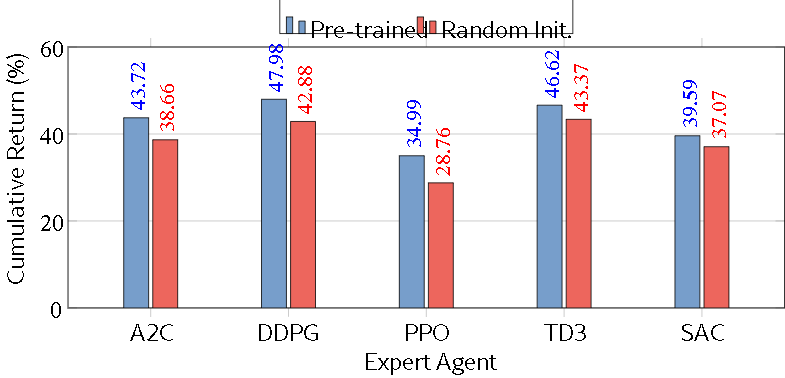

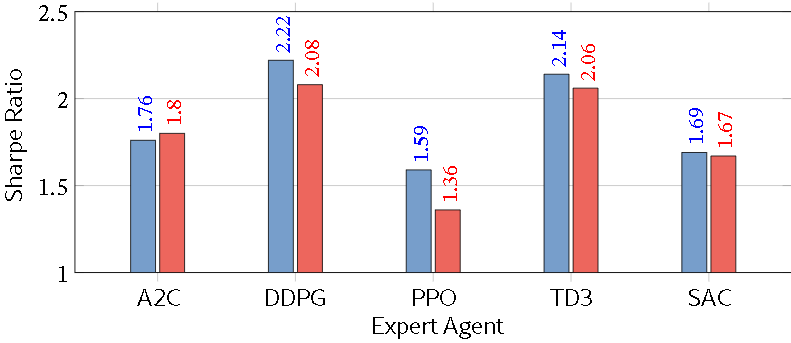

- 预训练权重的价值:图3清晰地展示了预训练GPT-2权重的巨大价值。在A2C、DDPG、PPO、TD3和SAC五种专家场景下,使用预训练权重的DT-LoRA-GPT2(深色柱)在累计收益上全面优于随机初始化的版本(浅色柱)。这验证了我们的核心假设:语言模型在通用文本上学到的“世界知识”或“模式识别能力”,确实能够迁移到金融时间序列的决策任务中,帮助模型更好地泛化。

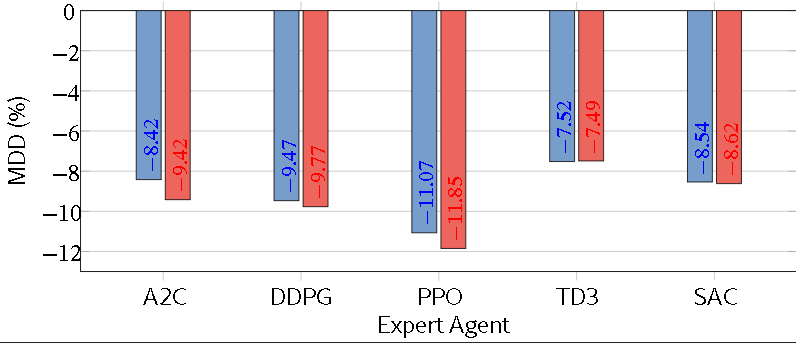

- 风险控制能力:在最大回撤(MDD)指标上,我们的模型也表现稳健。例如,在SAC专家下,我们的模型取得了所有方法中最佳的回撤控制(-8.54%),优于CQL和IQL等传统离线强化学习方法。这证明我们的模型不仅追求收益,也能有效管理下行风险。

图3:预训练权重与随机初始化权重在各类专家智能体上的性能对比

注:DT-LoRA-GPT2在各项指标上均持续优于随机初始化的对照模型,凸显了预训练语言模型权重的积极作用。

5. 稳健性检验与模型优化步骤

为确保结论的可靠性,我们进行了一系列稳健性检验和优化探索:

- 参数敏感性分析:我们测试了LoRA的秩(

r)值对模型性能的影响。较小的r值(如4、8)参数更少,但可能容量不足;较大的r值(如64、128)参数增多,但可能有轻微过拟合。最终我们选择了性能平衡的r=16。 - 上下文长度(K)的调整:我们尝试了不同的序列窗口长度(K=20, 50, 100)。较长的上下文(K=100)能提供更多历史信息,帮助模型捕捉长期依赖,但训练成本也相应增加。最终模型采用了K=100的设置。

- 专家策略的多样性检验:我们对比了在不同专家(A2C、DDPG等)轨迹上训练的模型表现。结果表明,我们的模型在不同专家数据上均能稳定学习,展现出良好的泛化能力,验证了其架构的鲁棒性。

- 数据质量检验:我们检查了训练数据中是否存在异常或缺失值,并进行了清洗。确保输入模型的数据质量是可靠性的基础。

模型优化与未来工作展望:

- 多专家轨迹融合:当前我们仅使用单一专家轨迹进行训练。未来可以探索如何有效融合多个不同专家的轨迹数据,构建一个更强大、更全面的离线策略。这就像集思广益,让模型从不同风格的交易员那里学习。

- 模型解释性提升:我们的模型基于语言模型,这为生成自然语言解释提供了可能。未来工作可以尝试让模型在做出交易决策的同时,生成一句简短的文本说明其决策依据,例如“基于近期成交量放大和价格突破阻力位,建议买入”。这能极大提升模型的透明度和可信任度,对金融决策至关重要。

DeepSeek、LangGraph和Python融合LSTM、RF、XGBoost、LR多模型预测NFLX股票涨跌|附完整代码数据

结合多模型预测NFLX股票涨跌的完整代码数据案例,探索深度学习与传统机器学习的融合应用。

探索观点6. 研究结论与写作提示

本研究提出并验证了一种新的离线强化学习框架,用于量化交易策略的学习。我们将决策变换器(DT)与预训练语言模型GPT-2相结合,并通过低秩适配(LoRA)进行高效微调。实证结果表明:

- 该框架能够有效从历史专家轨迹中学习交易策略,并在关键财务指标上(累计收益、夏普比率)表现出与主流离线强化学习方法(CQL、IQL)相当甚至更优的性能。

- 利用预训练语言模型的知识是成功的关键。相比于随机初始化的模型,我们的方法在各项指标上均有显著提升,证明了知识迁移在金融领域决策问题中的价值。

- 该方法在处理金融数据复杂时序依赖和风险控制方面展现出潜力。

对于正在撰写论文的同学,以下是一些实用建议:

- 文献综述部分:可以重点突出离线强化学习和序列建模(如Transformer)在金融领域应用的现有成果与局限,引出本文的创新点。

- 模型构建部分:详细描述DT模型的输入输出结构,以及如何将金融数据(状态、动作、收益)与语言模型对齐。重点解释LoRA的原理和引入它的好处(减少计算量、避免过拟合)。可以用流程图辅助说明。

- 实证分析部分:对比结果表格是核心。在解读时,不要只罗列数字,要分析数据背后的原因。例如,为什么模型在A2C专家上表现更好?可能A2C的探索策略产生的轨迹更多样化,更有利于DT学习。注意从风险和收益两个角度解读。

- 稳健性检验部分:这一部分能显著提升论文质量。可以像本文一样,简单描述对关键超参数(如上下文长度K、LoRA的秩r)的敏感性分析结果,说明模型性能的稳定性。

- 语言表达:避免使用口语化表达,多用专业术语(如“时序依赖”、“泛化能力”、“风险调整后收益”)。句子结构可以稍微复杂一些,但要保证逻辑清晰。

- AI合规与风险规避:

- 查重优化:本文提供的代码和模型结构部分,建议同学们结合自己的理解进行复述和变量名修改,避免直接复制。对于模型的理论介绍部分,也要用自己的话重新组织,加入自己的理解。

- AI生成内容规范:如果使用AI辅助写作(如润色、扩写),务必在论文末尾的致谢或注释中明确说明,这是学术规范的体现。

- 导师审核重点:导师通常会重点关注模型设计的合理性、实验设置的严谨性以及结果解读的逻辑性。确保你的每一步选择都有充分理由(比如,为什么选DT而不是传统RNN?为什么用离线强化学习?),并且你的实验结果能支持你的结论。

- 答辩高频提问:“你的模型和传统的Q-learning相比,本质区别是什么?”(答:将RL问题转化为序列建模问题,利用Transformer处理长程依赖)。“预训练的GPT-2权重真的有用吗?怎么证明?”(答:通过对比实验,用随机初始化的对照组证明)。“你的模型在真实市场能用吗?”(答:本文是基于历史数据的离线学习,是迈向真实应用的第一步,但还需考虑交易成本、市场冲击等因素)。

- 代码问题修复:运行代码时常见的错误包括:

pandas版本不兼容导致数据读取失败,gym环境版本问题,torch与cuda版本不匹配,以及模型输入输出维度错误。建议在运行前仔细检查requirements.txt。如遇到具体问题,欢迎加入我们的交流群寻求帮助。

阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。

学术与代码支持:本文提供的代码框架和思路,是结合学术前沿与实战经验的可复现方案。如您在模型适配、数据预处理、结果解读或代码调试上遇到困难,欢迎联系我们获取1v1专项辅导支持。我们提供从文献综述、模型构建、代码调试到论文润色的全流程服务,助力您的学术之路。

每日分享最新报告和数据资料至会员群

关于会员群

- 会员群主要以数据研究、报告分享、数据工具讨论为主;

- 加入后免费阅读、下载相关数据内容,并同步海内外优质数据文档;

- 老用户可九折续费。

- 提供报告PDF代找服务

非常感谢您阅读本文,如需帮助请联系我们!

2025-2026保健品行业报告:线上渠道、功效细分、种草营销 | 附80+份报告PDF、数据、可视化模板汇总下载

2025-2026保健品行业报告:线上渠道、功效细分、种草营销 | 附80+份报告PDF、数据、可视化模板汇总下载 2026脑机接口技术发展现状报告:市场格局与商业化落地 | 附60+份报告PDF、数据、可视化模板汇总下载

2026脑机接口技术发展现状报告:市场格局与商业化落地 | 附60+份报告PDF、数据、可视化模板汇总下载 2026年机器人产业:具身智能发展现状趋势报告:从春晚舞台到工厂车间|附80+份报告PDF、数据、可视化模板汇总下载

2026年机器人产业:具身智能发展现状趋势报告:从春晚舞台到工厂车间|附80+份报告PDF、数据、可视化模板汇总下载 OpenClaw与LLM融合对抗性辩论与风险约束的多智能体量化交易系统设计与实现自动化投资架构 |附代码数据

OpenClaw与LLM融合对抗性辩论与风险约束的多智能体量化交易系统设计与实现自动化投资架构 |附代码数据