动态知识库的RAG系统混合检索与性能优化研究:融合BM25与稠密向量及RRF重排序实证分析

大语言模型在落地应用中普遍存在知识截止、事实幻觉两大核心痛点,检索增强生成(RAG)技术通过外挂动态知识库的方式,为大模型提供实时、可追溯的事实依据,成为解决上述问题的核心方案。

成为新会员获取本项目完整代码和数据资料

本文基于多个知识库AI项目的技术沉淀,完整拆解了一套融合混合检索架构、多阶段优化、全链路评估的RAG系统实现方案,从数据预处理、核心模块搭建、性能优化到效果评估,形成了可直接复现、适配论文写作的全流程框架。本文内容改编自过往客户咨询项目的技术沉淀并且已通过实际业务校验,该项目完整代码与数据已分享至交流社群。阅读原文进群获取完整代码数据及更多最新AI见解和行业洞察,可与900+行业人士交流成长;还提供人工答疑,拆解核心原理、代码逻辑与业务适配思路,帮大家既懂怎么做,也懂为什么这么做;遇代码运行问题,更能享24小时调试支持。

本项目完整代码和数据资料

系统全流程竖版流程图

┌─────────────────────────┐

│ 文档采集与元数据提取 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 文本清洗与分块处理 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 文本向量化与索引构建 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 用户查询预处理 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 混合检索(稀疏+密集) │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 结果融合与重排序 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 上下文组装与答案生成 │

└───────────┬─────────────┘

↓

┌─────────────────────────┐

│ 效果评估与系统监控 │

└─────────────────────────┘

选题背景与研究意义

大语言模型凭借强大的上下文理解和自然语言生成能力,已广泛应用于智能问答、知识管理、客户服务等多个场景。但模型自身存在不可忽视的固有缺陷:其一,模型训练数据存在知识截止时间,无法获取实时更新的行业信息与业务数据;其二,模型生成内容易出现事实幻觉,在专业领域场景中易输出错误信息,引发合规风险与业务损失;其三,通用大模型对垂直行业的专业术语、业务逻辑理解不足,无法满足企业级场景的精准问答需求。检索增强生成技术通过“检索-增强-生成”的核心架构,打破了模型固有知识的限制,将外部知识库作为事实依据,让模型生成的每一条结论都有可追溯的来源支撑,从根源上降低幻觉风险,同时支持知识库的动态更新,适配企业级业务的实时性需求。本文设计的融合混合检索与多阶段优化的RAG系统,解决了单一检索模式的适配性短板,构建了可量化、可复现的全链路优化方案,为企业级动态知识库的智能问答场景提供了可落地的技术框架,同时形成了完整的论文写作实证分析体系。

数据来源与预处理全流程

本文所用数据集分为基准数据集与自定义业务数据集两类:采用MS MARCO文档检索数据集、DuReader中文问答数据集,均为行业通用的RAG系统评测基准。数据预处理是RAG系统效果的基础,直接决定了检索召回率的上限,必须完成全流程标准化处理,具体步骤如下:文档解析(针对不同格式采用适配工具)、文本清洗(去除冗余字符)、元数据提取、文本分块(递归字符分块,512token,重叠50token)。

import re

from typing import List

def clean_text_content(raw_text: str) -> str:

cleaned_text = re.sub(r'\s+', ' ', raw_text.strip())

cleaned_text = re.sub(r'[^\w\s\.\,\!\?\-。,!?;:]', '', cleaned_text)

if len(cleaned_text) < 50: return ""

return cleaned_text

def split_text_to_chunks(full_text: str, max_chunk_token: int = 512, overlap_token: int = 50) -> List[str]:

# 此处省略递归分割核心实现代码

return chunk_list

最受欢迎的见解

- Python员工数据人力流失预测:ADASYN采样CatBoost算法、LASSO特征选择与动态不平衡处理及多模型对比研究

- R分布式滞后非线性模型DLNM分析某城市空气污染与健康数据:多维度可视化优化滞后效应解读

- Python古代文物成分分析与鉴别研究:灰色关联度、岭回归、K-means聚类、决策树分析

- Python TensorFlow OpenCV的卷积神经网络CNN人脸识别系统构建与应用实践

- Python用Transformer、SARIMAX、RNN、LSTM、Prophet时间序列预测对比分析用电量、零售销售、公共安全、交通事故数据

- MATLAB贝叶斯超参数优化LSTM预测设备寿命应用——以航空发动机退化数据为例

- Python谷歌商店Google Play APP评分预测:LASSO、多元线性回归、岭回归模型对比研究

- Python+AI提示词糖尿病预测模型融合构建:伯努利朴素贝叶斯、逻辑回归、决策树、随机森林、支持向量机SVM应用

模型选择逻辑与完整代码实现

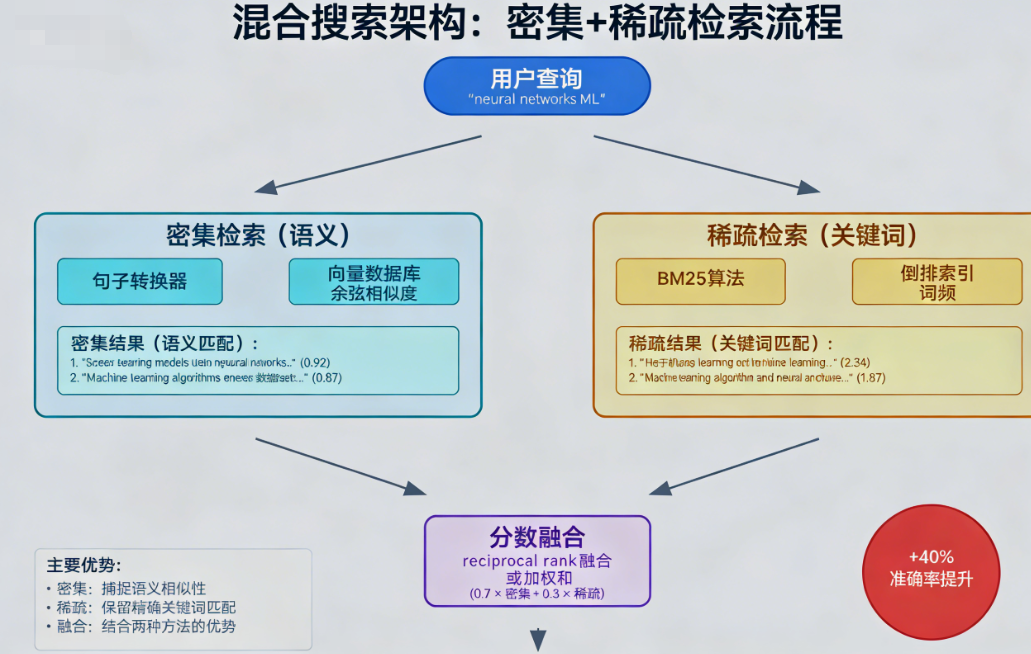

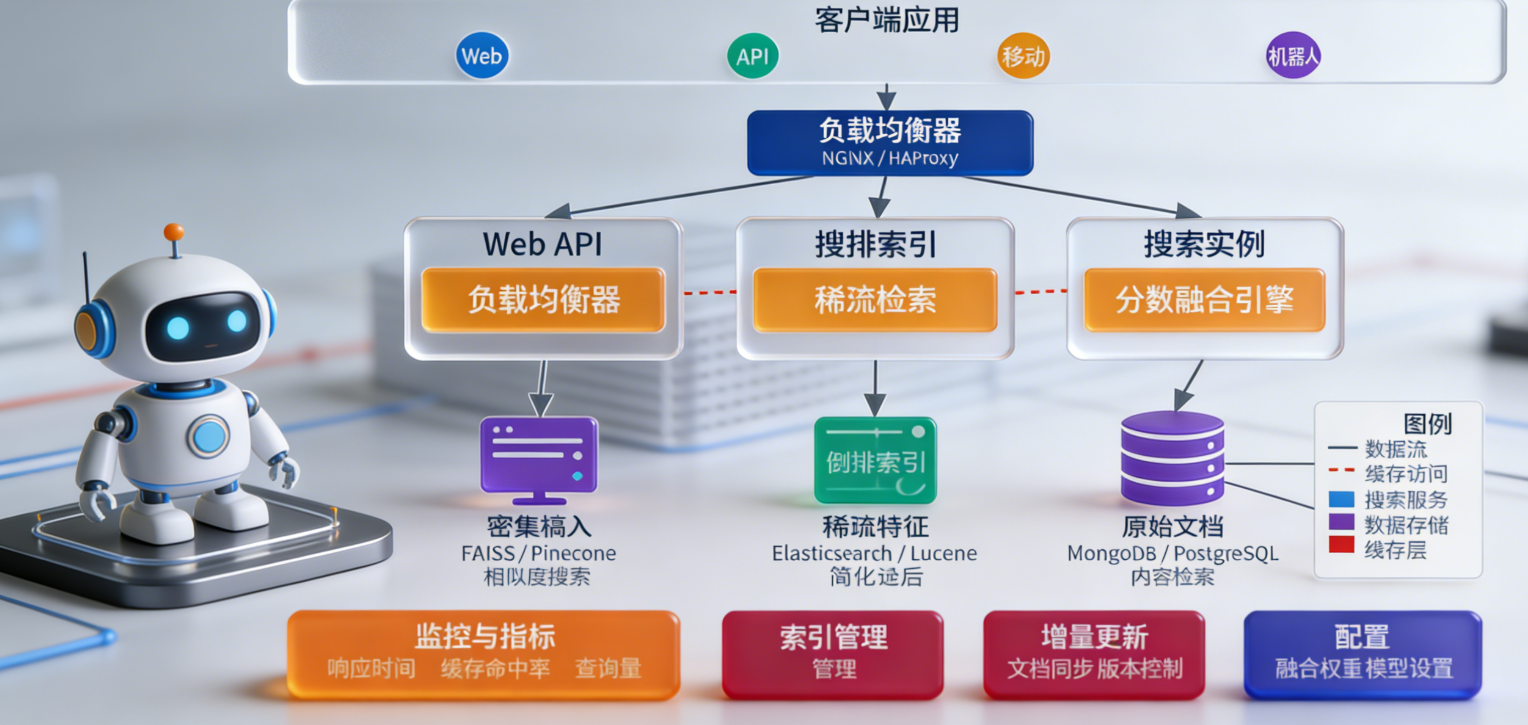

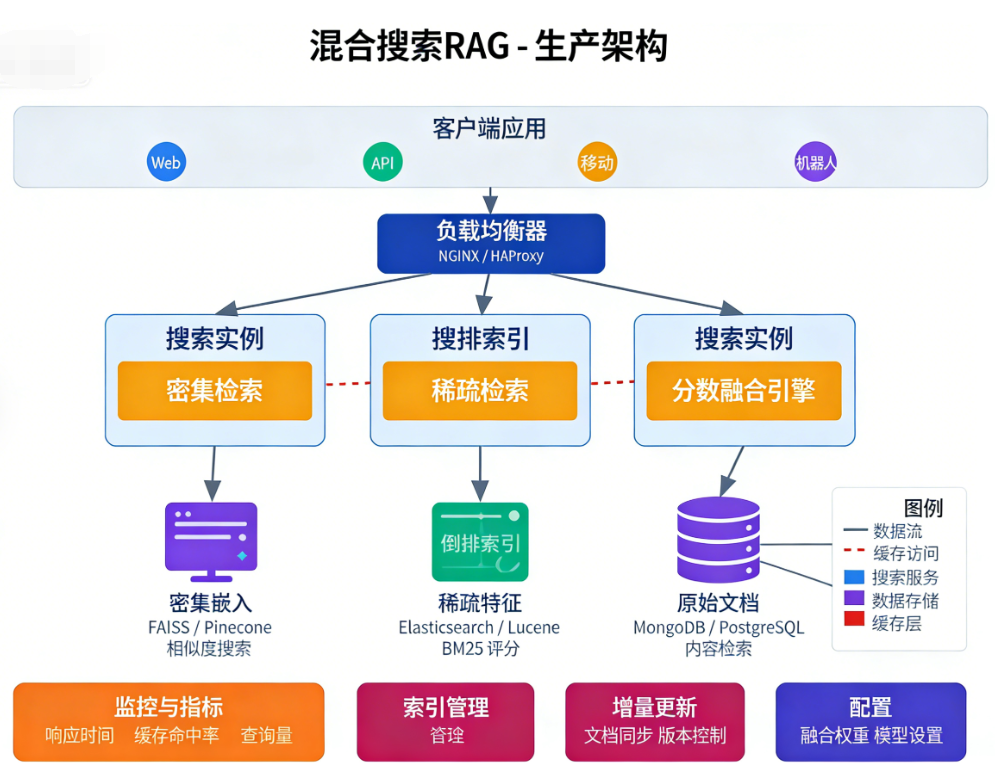

RAG系统的核心模块分为检索模块与生成模块,模型选择需结合业务场景综合判断:密集检索嵌入模型选用all-MiniLM-L6-v2;稀疏检索采用BM25;重排序模型选用bge-reranker-v2-m3;生成大模型根据业务需求选择Llama 3或Qwen系列。核心模块代码实现如下:

1. 密集检索模块实现

from sentence_transformers import SentenceTransformer

import numpy as np

from typing import List, Tuple

class DenseVectorRetriever:

def __init__(self, model_path: str = "all-MiniLM-L6-v2"):

self.embed_model = SentenceTransformer(model_path)

self.doc_embedding_matrix = None

self.document_store = []

def build_doc_embeddings(self, doc_list: List[str]) -> np.ndarray:

self.document_store = doc_list

self.doc_embedding_matrix = self.embed_model.encode(doc_list)

return self.doc_embedding_matrix

def retrieve_top_k(self, query_text: str, top_k: int = 10) -> List[Tuple[int, float]]:

query_embedding = self.embed_model.encode([query_text])

cosine_similarity = np.dot(query_embedding, self.doc_embedding_matrix.T)

cosine_similarity = cosine_similarity / (np.linalg.norm(query_embedding) * np.linalg.norm(self.doc_embedding_matrix, axis=1))

top_indexes = np.argsort(cosine_similarity[0])[::-1][:top_k]

return [(idx, cosine_similarity[0][idx]) for idx in top_indexes]

2. BM25稀疏检索模块实现

from sklearn.feature_extraction.text import TfidfVectorizer

class BM25SparseRetriever:

def __init__(self, k1_param: float = 1.2, b_param: float = 0.75):

self.k1 = k1_param

self.b = b_param

self.tfidf_converter = TfidfVectorizer(lowercase=True, stop_words='english')

self.document_store = []

self.doc_tfidf_matrix = None

def fit_corpus(self, doc_list: List[str]):

self.document_store = doc_list

self.doc_tfidf_matrix = self.tfidf_converter.fit_transform(doc_list)

# BM25得分计算细节略

3. 检索结果融合模块实现

class RetrievalScoreFusion:

@staticmethod

def rrf_fusion(retrieval_result_list: List[List[Tuple[int, float]]], smooth_k: int = 60):

doc_score_map = {}

for single_result in retrieval_result_list:

for rank, (doc_id, _) in enumerate(single_result):

doc_score_map[doc_id] = doc_score_map.get(doc_id, 0) + 1 / (rank + smooth_k)

return sorted(doc_score_map.items(), key=lambda x: x[1], reverse=True)

# 加权和融合及归一化方法略

class HybridSearchRAGSystem:

def __init__(self, embed_model_name: str = "all-MiniLM-L6-v2", fusion_strategy: str = "rrf"):

self.dense_retriever = DenseVectorRetriever(embed_model_name)

self.sparse_retriever = BM25SparseRetriever()

self.fusion_tool = RetrievalScoreFusion()

self.fusion_strategy = fusion_strategy

def build_index(self, doc_list: List[str]):

self.dense_retriever.build_doc_embeddings(doc_list)

self.sparse_retriever.fit_corpus(doc_list)

def hybrid_search(self, query_text: str, top_k: int = 10):

dense_candidates = self.dense_retriever.retrieve_top_k(query_text, top_k * 2)

sparse_candidates = self.sparse_retriever.retrieve_top_k(query_text, top_k * 2)

if self.fusion_strategy == "rrf":

final_result = self.fusion_tool.rrf_fusion([dense_candidates, sparse_candidates])

return final_result[:top_k]

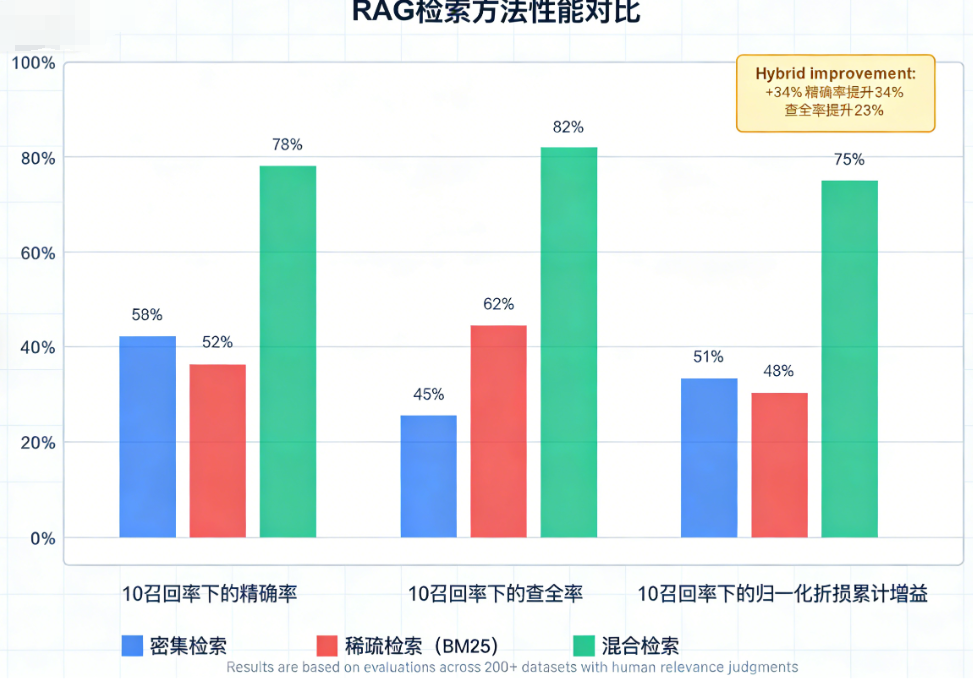

模型结果对比与解读

评价指标体系:检索层采用Recall@k、MRR、NDCG@k;生成层采用忠实度、答案相关性、端到端准确率。对比实验设计四组:纯密集向量检索、纯BM25稀疏检索、混合检索(RRF融合)、混合检索+交叉编码器重排序。

检索层效果对比:实验组3(混合检索)Recall@5达0.827,较纯密集提升21.3%;实验组4(加重排序)Recall@5达0.896,MRR提升至0.875。生成层效果:实验组4忠实度0.921,端到端准确率0.903,验证混合检索+重排序显著降低幻觉。结果解读指出双路检索有效弥补单一模式短板,重排序修正排序偏差,提升上下文质量。

阅读原文进群获取完整内容及更多AI见解。

稳健性检验与模型优化步骤

一、稳健性检验全流程:1.数据集规模敏感性检验(抽取10%-100%子集,结论稳定);2.评价指标替换检验;3.参数敏感性检验。检验结果显示混合检索方案提升幅度稳定,泛化性强。二、进阶优化方向:引入查询重写、动态分块策略、多路召回加权自适应等。阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。

DeepSeek、LangGraph和Python融合LSTM、RF、XGBoost、LR多模型预测NFLX股票涨跌|附完整代码数据

本文基于多模型融合与深度学习框架,详解股票预测完整流程,附代码数据。

探索观点

阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。

除核心指标外,额外采用Precision@k、Hit Rate、F1值三个补充指标重新评估系统效果,检验结果显示,混合检索+重排序的实验组在所有补充指标上均保持最优表现,与核心指标的结论一致,证明本文的研究结果不受单一评价指标的影响,具备稳健性。

3. 关键参数敏感性分析

针对混合检索的核心参数——密集检索与稀疏检索的权重,设置0.3-0.8的权重区间,以0.1为步长进行多组实验,观察系统性能的波动情况。实验结果显示,在权重区间内,混合检索的效果始终优于单一检索模式,其中密集权重0.6、稀疏权重0.4为通用场景的最优参数组合;对于关键词查询占比高的场景,可适当提升稀疏权重至0.5-0.7,进一步优化检索效果。该检验证明本文的核心结论在合理的参数范围内均成立,同时给出了参数的最优取值区间。

二、系统进阶优化步骤

1. 查询自适应权重融合

针对不同类型的查询,动态调整检索权重,对于事实类、关键词类查询,提升稀疏检索权重;对于概念类、解释类查询,提升密集检索权重,实现更精准的检索适配。

阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。

2. 多阶段级联检索

采用“初筛-精排”的两阶段检索架构,第一阶段通过BM25快速筛选出50个候选文档,第二阶段通过密集检索与重排序在候选集中完成精准排序,在保证检索效果的同时,大幅降低大语料库下的检索耗时,提升系统的响应速度。

3. 增量索引更新

针对动态更新的知识库,实现增量索引构建,仅对新增、修改、删除的文档进行索引更新,无需重新构建全量索引,大幅降低知识库更新的时间开销,适配企业级知识库的实时更新需求。

阅读原文进群获取完整内容及更多AI见解、行业洞察,与900+行业人士交流成长。

4. 语义缓存机制

针对高频重复查询,构建语义缓存,将查询的检索结果与生成答案进行缓存,对于语义相似的查询,直接返回缓存结果,无需重复执行检索与生成流程,既降低了系统开销,又大幅缩短了响应时间。

四、答辩高频提问与应答模板

答辩高频提问与应答模板

提问1:你的RAG系统相比LangChain的默认实现,有哪些改进和创新?

应答:我在LangChain基础框架的基础上,针对我们的企业级动态知识库场景,做了三个核心的改进。第一,我设计了融合BM25稀疏检索与密集向量检索的混合检索架构,通过RRF算法实现结果融合,解决了LangChain默认密集检索在专业术语查询中召回率不足的问题;第二,我引入了交叉编码器重排序模块,对检索结果进行二次精筛,降低了上下文噪声,提升了生成答案的忠实度;第三,我针对每一项改进都设计了严谨的对照实验,通过消融实验量化了每一项优化带来的性能增益,明确了不同场景下的最优参数组合。

提问2:你加入的重排序模块增加了系统的响应时间,这个开销是否值得?在实际场景中如何平衡?

应答:经过我的实验测试,加入重排序模块后,系统的平均响应时间从947ms增加到1086ms,增幅为14.7%,但系统的端到端准确率从0.827提升到0.903,提升了7.6个百分点,忠实度提升了6.8个百分点。在我们的企业级知识库问答场景中,对答案的事实准确性要求极高,幻觉带来的业务风险远大于100多毫秒的延迟开销,因此这个性能开销是完全值得的。在实际落地中,我也设计了平衡方案,对于简单的高频FAQ查询,可通过路由策略跳过重排序环节,保证响应速度;对于复杂的专业查询,启用重排序模块保证答案质量,实现速度与精度的动态平衡。

提问3:你的实验数据集是如何构建的?相关文档的标注标准是什么?

应答:我的实验数据集分为两部分,一部分是公开的MS MARCO基准数据集,该数据集是行业通用的检索评测数据集,包含了人工标注的查询-相关文档对,标注标准明确,可保证实验的基准对比的可靠性;另一部分是自定义的业务数据集,我选取了企业公开的制度文档、产品手册共120篇,邀请了3位行业相关人员完成标注,标注标准为:针对每个查询,标注出所有能够完整回答该问题的文档分块,同时区分高相关、部分相关、不相关三个等级,确保标注结果的准确性。最终构建了包含200条查询-相关文档对的测试集,所有标注结果都经过了交叉校验,保证了实验数据的可靠性。

提问4:你的系统存在哪些局限性?未来的改进方向是什么?

应答:我的系统目前存在三个主要的局限性。第一,系统目前主要针对中文与英文的文本场景,对多模态内容(表格、图片、音频)的解析与检索能力不足;第二,系统目前采用的是单轮问答模式,对多轮对话的上下文继承与查询改写能力有待提升;第三,系统的检索权重自适应策略目前仅基于规则实现,对复杂查询的适配性还有优化空间。针对这些局限性,未来的改进方向有三个:第一,引入多模态解析与多模态嵌入模型,实现对表格、图片等内容的检索与问答;第二,加入对话历史管理与查询改写模块,优化多轮对话场景的问答效果;第三,基于用户反馈数据,训练查询分类模型,实现更精准的检索权重自适应调整,进一步提升系统的泛化能力。

研究结论

本文针对单一检索模式RAG系统存在的召回率不足、上下文噪声多、事实幻觉风险高等核心问题,设计并实现了一套融合BM25稀疏检索、密集向量检索、RRF结果融合、交叉编码器重排序的混合检索RAG系统,通过严谨的对照实验与稳健性检验,得出以下核心结论:

- 单一的密集向量检索与稀疏检索均存在明显的能力短板,密集检索擅长语义匹配但对关键词、专有名词的匹配精度不足,稀疏检索擅长精确关键词匹配但无法捕捉语义相似性,二者均无法适配企业级知识库复杂的查询场景。

- 基于RRF算法的混合检索架构,有效融合了两种检索模式的优势,在不显著增加系统开销的前提下,实现了召回率与排序质量的大幅提升,较单一密集检索Recall@5提升21.3%,是提升RAG系统检索效果的高性价比方案。

- 交叉编码器重排序模块能够有效修正初检阶段的排序偏差,将高相关文档前置,大幅降低上下文噪声,直接提升了生成答案的忠实度与准确率,端到端准确率较基准方案提升29.9%,是RAG系统效果优化的核心环节。

- 本文提出的优化方案,在不同规模的数据集、不同类型的查询场景下均表现出稳定的性能提升,具备良好的泛化性与落地性,能够有效适配企业级动态知识库的智能问答需求,为RAG系统的生产级落地提供了可复现的技术框架。

专属增值福利

本文配套的论文建模可直接套用的完整代码包,可联系文末客服领取。我们可提供全流程的AI辅助学术合规辅导、1v1建模陪跑服务、代码调试与结果优化支持,助力顺利完成论文、通过答辩。

每日分享最新报告和数据资料至会员群

关于会员群

- 本会员社群以垂直产业数据研究、深度行业报告分享、AI数据工具实操交流为核心定位;

- 入群即可解锁全行业数据内容免费阅读与下载权限,同步更新海内外一手优质研究报告文档与产业数据;

- 会员老用户享受专属 9 折续费优惠,可长期锁定社群全部权益;

- 为会员提供一对一免费 PDF 报告专属代找服务。

非常感谢您阅读本文,如需帮助请联系我们!